למעלה מ-50 מומחים אקדמיים בתחום הבינה המלאכותית הכריזו כי יטילו חרם על מוסד אקדמי נחשב בדרום קוריאה בשם KAIST (ראשי תיבות באנגלית של "המכון המתקדם למדע וטכנולוגיה של קוריאה") המדורג שני בדירוג האוניברסיטאות שם, וזאת כיון שהמוסד חתם על שותפות עם יצרן נשק מוביל בקוריאה, להקמת מרכז מחקר שיוביל לפיתוחם של כלי נשק מונחי בינה מלאכותית.

"בתקופה שבה האו"ם דן כיצד להכיל את האיום הנשקף לביטחון הבינלאומי על ידי נשק אוטונומי, מצער כי מוסד יוקרתי כמו KAIST, מאיץ את מרוץ החימוש לפתח נשק כזה", נכתב במכתב שנשלח למכון, שבו הם מאיימים לחדול משיתוף פעולה אקדמי עם המוסד.

המחרימים הוסיפו וכתבו כי "אם יפותח נשק אוטונומי, הנשק הזה ייצור את המהפכה העולמית השלישית בתחום הלחימה. מלחמות יהיו מהירות יותר ובקנה מידה גדול מאי פעם וישנה אפשרות כי כלי נשק כאלה ישמשו למטרות טרור. כמו כן עריצים וטרוריסטים יוכלו להשתמש בנשק נגד אוכלוסיות חפות מפשע".

הקריאות לחרם התעצמו לקראת מפגש מיוחד השבוע באו"ם שיעסוק בשאלה האם יש להטיל חרם עולמי על הפיתוח של מכונות הרג עם בינה מלאכותית עצמאית.

בינתיים האוניברסיטה הקוריאנית עצמה הכחישה כי היא אכן מפתחת נשק מהסוג הזה. נשיא KAIST סונג צ'ול שין, פרסם הודעה בה נכתב כי הוא מצר על האיום בחרם, הכחיש את הכוונות לפתח מערכת נשק אוטונומיות קטלניות והוסיף:

"המרכז המתוכנן אמור לפתח אלגוריתמים למערכות לוגיסטיות חכמות, ניווט בלתי מאויש ומערכות אימון לתעופה", אומר שין. "KAIST תהיה אחראית לחינוכם של החוקרים ולספק להם הכוונה", אומר נשיא המוסד.

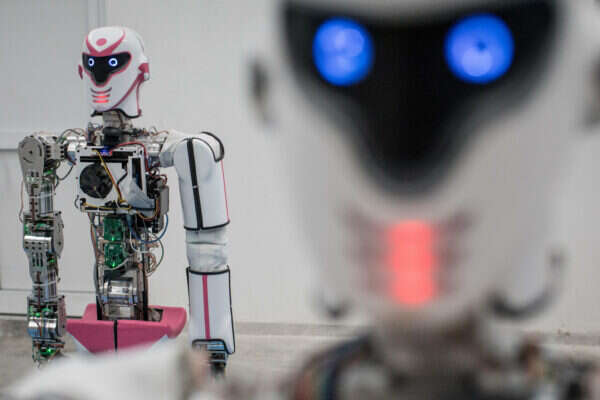

"אני רוצה להדגיש כי ל-KAIST אין כוונות לפתח כלי נשק אוטונומיים קטלניים ורובוטים רצחניים. אנחנו מודעים משמעותית לבעיות האתיות שביישום כל טכנולוגיה, לרבות בינה מלאכותית".

בתוך כך, מתכנסת היום בג'נבה קבוצת מומחים ממשלתיים ל-"מערכות נשק אוטונומיות קטלניות" או ראשי התיבות LAWS באנגלית. הקבוצה תקיים שבוע של דיונים כעת ועוד שבוע באוגוסט. השגריר אמנדיפ סינגה גיל ההודי, עומד בראש קבוצת העבודה של האו"ם לנושא. ב-2015, חתמו שורה של אנשי טכנולוגיה ומדענים בולטים כמו אילון מאסק וסטיבן הוקינג, על גילוי דעת המזהיר מפני סכנותיה של הבינה המלאכותית.